De Universiteit Leiden haalde afgelopen week op ongewenste wijze het nieuws. Studenten en docenten gingen de straat op om te demonstreren en beklaagden zich zowel in de krant als in TV-programma’s over het feit dat de Universiteit een nieuw camera-systeem heeft geïnstalleerd. Om het aantal aanwezige studenten te kunnen tellen, zo stelt de Universiteit. Hetgeen van belang is in het kader van handhaving van de Corona-regels. Echter, de camera’s blijken tot veel meer in staat. Waardoor diverse betrokkenen zich zorgen maken over hun privacy.

Het gewraakte systeem

In totaal zijn er 371 camera’s geïnstalleerd door de Universiteit. Deze zijn van het Zwitserse merk Xovis. Hoewel de Universiteit spreekt van classroom scanners gaat het wel degelijk om camera’s die opnames kunnen maken. De camera’s zijn voorzien van verschillende privacy-niveaus en van Artificial Intelligence software. Afhankelijk van het ingestelde privacy-niveau kunnen de camera’s nog veel meer dan alleen het aantal aanwezigen in een ruimte tellen. Zo kan het geslacht of de etniciteit van bezoekers worden bepaald en kan het systeem bijvoorbeeld ook waarnemen of iemand een mondkapje draagt. Volgens de Universiteit Leiden is bij hen het hoogste privacy-niveau ingesteld, wat betekent dat alleen het silhouet van personen wordt waargenomen. Iets wat voldoende is om het aantal aanwezigen te tellen.

De (mogelijke) bezwaren

Belangrijkste bezwaar van studenten en docenten is inderdaad dat het systeem veel meer kan dan datgene waar het voor bestemd is, namelijk het aantal aanwezige personen tellen. Daarmee is het zogenaamde proportionaliteitsbeginsel in het geding. Waarmee wordt bedoeld dat de maatregelen die je treft in verhouding moeten zijn tot het probleem wat je wilt oplossen of het risico dat je wilt afdekken.

Sommigen stellen ook dat veel eerder gecommuniceerd had moeten worden dat het systeem werd geïnstalleerd en voor welk doel, maar volgens de woordvoerder van de universiteit was dit niet persé vereist omdat er volgens de universiteit geen persoonsgegevens verwerkt worden (gegeven het ingestelde privacy-niveau).

Tenslotte is aangevoerd dat er ten onrechte geen Data Protection Impact Analysis (DPIA) is uitgevoerd, maar volgens de Functionaris Gegevensbescherming van de universiteit is de afweging om dit wel of niet te doen wel degelijk gemaakt en was dit niet nodig.

Wat kunnen we ervan leren

Wat we allereerst van deze case kunnen leren is dat transparantie en tijdige en heldere communicatie van groot belang zijn. Er is bijvoorbeeld nog maar zeer recent gecommuniceerd dat het systeem is opgehangen, terwijl de camera’s er al een jaar hangen. Dit leidt tot onnodig wantrouwen.

Door proactief te communiceren had men bijvoorbeeld óók duidelijk kunnen maken dat er weliswaar eenvoudiger systemen zijn uitgeprobeerd, maar dat deze in de praktijk niet voldeden. Zo had men de regie kunnen houden en was men niet in de verdediging gedrukt.

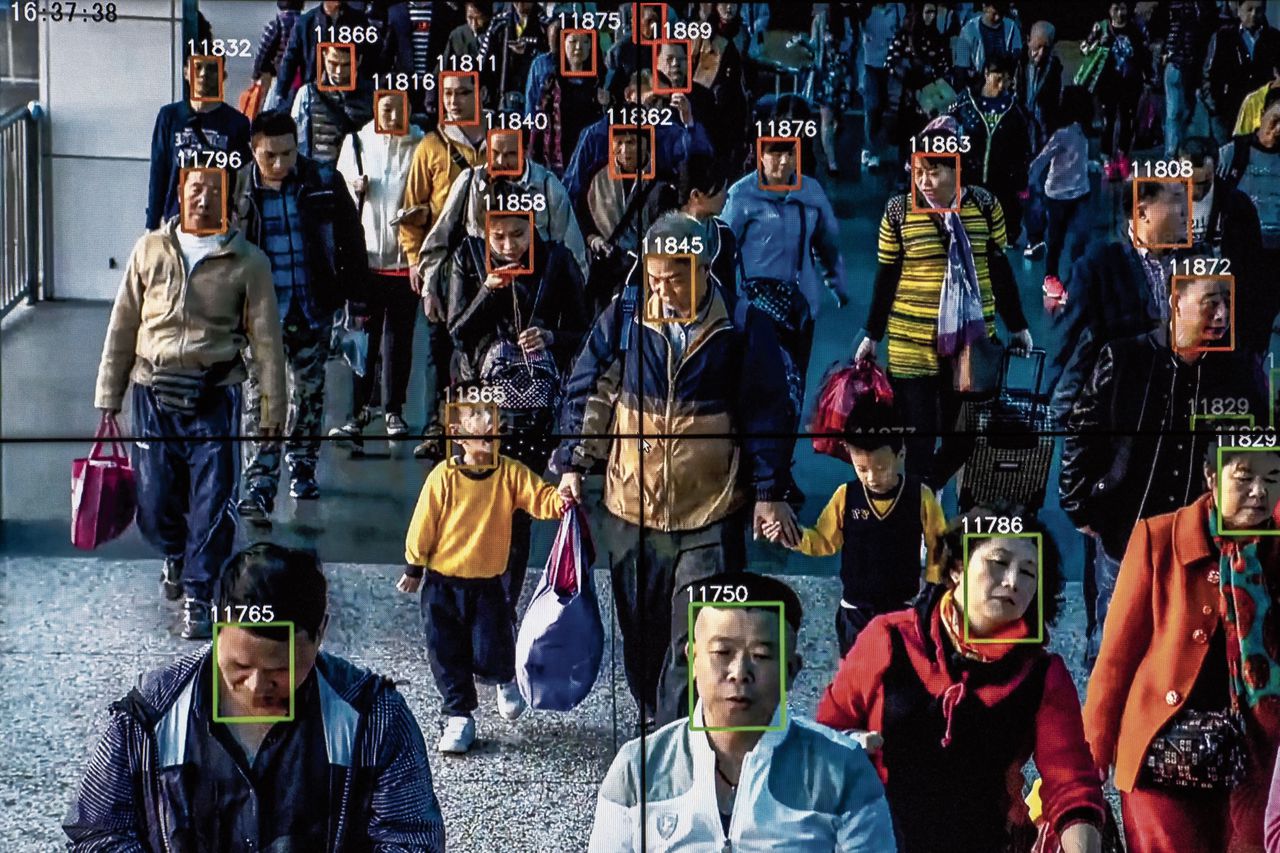

Wat deze case ook nog maar eens duidelijk maakt is hoe gevoelig camera-toezicht ligt bij een grote groep mensen. Zeker wanneer het gecombineerd wordt met Artificial Intelligence. Een zich snel ontwikkelende technologie die veel mogelijkheden biedt maar inderdaad ook grote risico’s op het gebied van privacy met zich meebrengt. In een land als China weten ze hier alles van. In dit kader is het wellicht raadzaam bij de introductie van nieuwe technologie die deze technologie omvat altijd een DPIA uit te voeren, ook als de inschatting is dat dit niet nodig is.

Better safe than sorry, zeg maar. Daarmee voorkom je wellicht dat je net als de Universiteit Leiden moet terug komen op je stappen. Onder druk van de negatieve pers heeft het College van Bestuur inmiddels namelijk besloten het systeem buiten werking te stellen. Toch jammer van een investering van Eur 200.000,–.

Auteur: Bert van de Bovenkamp